Miru: engenharia reversa de redes neurais

Fala, pessoal!

Paixão por conhecimento e criação são pilares da return moe;. Apostamos num modelo AI-first, com inteligência artificial no centro dos nossos projetos. Mas não é só usar as ferramentas: queremos entender como elas funcionam por dentro, contribuir pro desenvolvimento delas, e compartilhar isso com a comunidade.

Por isso, estamos de olho em interpretabilidade mecanicista (do inglês “mechanistic interpretability”), o campo de pesquisa que busca desvendar o funcionamento interno de redes neurais. Ele aborda questões como: quais circuitos são ativados? Como a informação flui pelas camadas do modelo? Como certas decisões são tomadas?

Em resumo, é a engenharia reversa de redes neurais.

Uma nova iniciativa

Estamos lançando a Miru (do japonês 見る, “ver/observar”), uma iniciativa dedicada a desenvolver ferramentas de interpretabilidade mecanicista.

Nosso primeiro projeto sob essa bandeira é a Miru Tracer, que já está disponível no nosso GitHub.

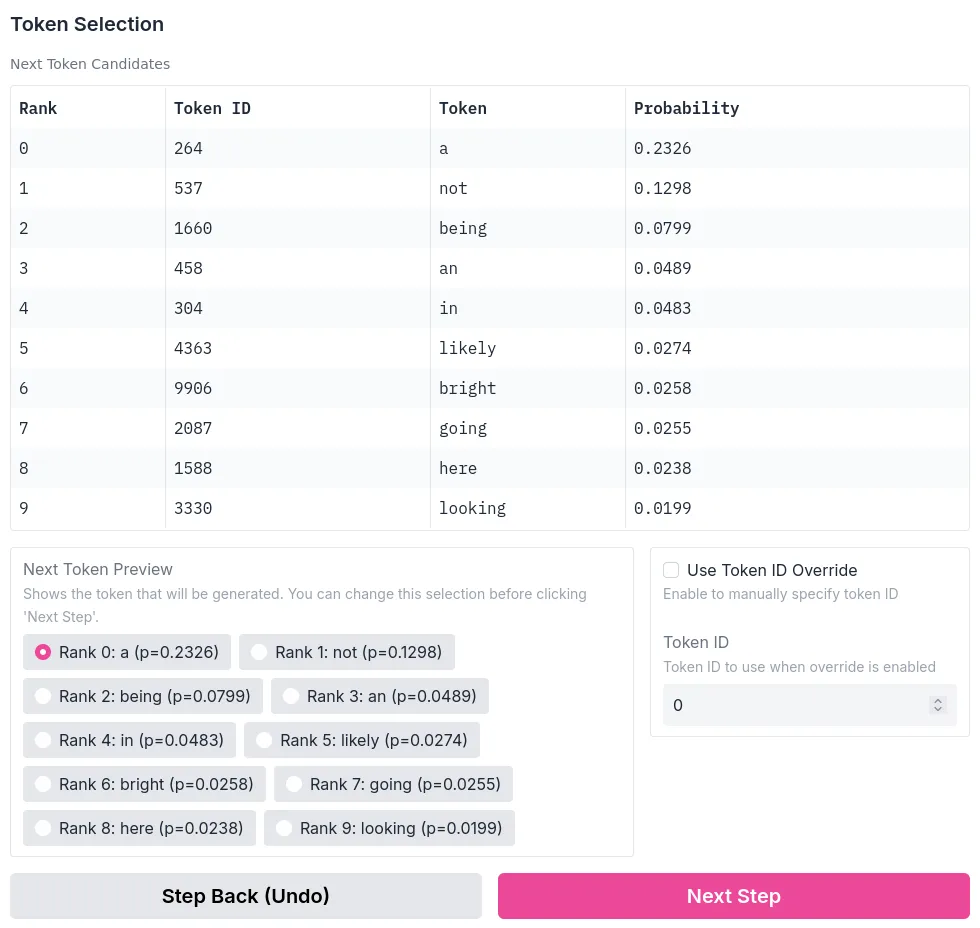

Trata-se de uma aplicação Gradio que carrega modelos de linguagem a partir da plataforma Hugging Face, realiza a inferência com a Transformers, e produz análise de confiança (confidence analysis) por probabilidade e entropia. Ela conta também com um modo interativo, pelo qual pode-se intervir manualmente no processo de seleção de cada token.

Exemplo do modo interativo da Miru Tracer

E o que vem por aí?

A Miru Tracer é simples, mas representa nosso primeiro passo num campo ainda emergente e complexo.

Como a ferramenta permite análises acessíveis, visuais e interativas, acreditamos que ela pode despertar interesse pela interpretabilidade mecanicista em quem usa IA mas ainda não parou pra pensar sobre como os modelos funcionam. Por isso, uso educacional é prioridade para nós.

No mais, queremos explorar técnicas de activation steering, que consiste em influenciar resultados através da manipulação das ativações internas da rede neural. Elas abrem um novo caminho pra introduzir e modificar comportamentos do modelo, indo além de prompting e finetuning.

Dúvidas, sugestões, ou só quer conversar sobre isso? Me chama lá no Telegram (@rlaneth)! Vamos seguir em frente, um token de cada vez. 💜